人聲分離技術

01. 核心技術介紹

本程式整合了 Meta (Facebook) 開發的頂尖音樂分離模型 Hybrid Transformer Demucs (htdemucs),為您提供錄音室等級的音軌分離服務。

不同於傳統的 EQ 濾波,AI 模型能真正「聽懂」音樂中的不同樂器,將其完美拆解為:

- 🎤 Vocals (人聲):保留歌手的演唱細節。

- 🥁 Drums (鼓組):獨立的打擊樂軌道。

- 🎸 Bass (貝斯):低頻樂器軌道。

- 🎹 Other (伴奏):鋼琴、吉他、合成器等其他樂器。

02. 支援模型解析

我們精選了三種最強大的預訓練模型,滿足不同場景需求:

🚀 htdemucs V4 (標準版 - 速度快) 預設

這是 Demucs V4 的標準版本,兼顧了分離品質與處理速度。適合 90% 的使用場景,特別是製作卡拉 OK 伴奏。

🎯 htdemucs_ft (精修版 - 音質細)

Fine-tuned 版本特別針對「保留人聲細節」進行了優化。如果您是為了提取乾聲來進行 AI 翻唱訓練,此模型通常能保留更多高頻細節。

💎 mdx_extra (MDX-Net V3 - 最佳音質 HQ)

這是基於 MDX-Net 架構的頂級高品質模型。它能提供目前業界頂尖的分離純淨度,特別適合對音質有極高要求的用戶。

03. ⚠️ 重大觀念:為什麼分離出來還有回音?

這是一個非常專業且常見的問題!Demucs 等「人聲分離」模型的主要任務是「將人聲與背景樂器聲 (BGM) 分開」。

然而,從流行歌曲或影片中分離出來的人聲,通常都帶有強烈的空間混響 (Reverb)、回音 (Echo) 或是和聲 (Chorus)。這是因為歌手在錄音室錄音或後期製作時,混音師故意加上去的「空間化特效」,讓聲音聽起來更飽滿、圓潤。

這對 AI 翻唱 (RVC) 有什麼影響?

- 致命影響: 如果在訓練 RVC 或 GPT-SoVITS 模型時,把帶有「回音/混響」的聲音丟給 AI 學習,AI 會「誤認」殘響是該歌手音色的一部分。

- 結果: 訓練出來的模型,講話會永遠自帶一種在山洞裡的空靈感,聲音模糊、不貼耳。

※ 為什麼「去回音」後,聲音聽起來怪怪的/不像原唱?

當您勾選了 「☑️ 啟用去回音過濾」 並聽取產出的 _Vocal_Dry.wav

時,您可能會覺得聲音變得很單薄、甚至有點電音感。這是正常的「錄音室魔法剝奪效應」,原因如下:

- 和聲與疊軌 (Doubling): 流行歌曲通常在主唱背後疊加了多軌和聲。去回音模型只會拔除「空間殘響」,但無法刪除和聲。因此您會聽到多個人的聲音疊在一起的詭異空間感。

- 素顏的聲音: 混音師在製作 CD 時,會使用百萬級的 EQ 與混響器將歌手聲音修飾得極其圓潤。當 AI 將這些「化妝品」粗暴地抽乾後,留下來的自然是最乾癟、未經修飾的真實乾音。

🏆 如何取得最高品質的 AI 訓練素材?

要訓練出 S 級完美的變聲或語音克隆模型,最頂級的素材從來都不是流行歌曲 (CD),而是:

- Podcast 訪談片段

- 廣播節目 (Radio Show)

- 清唱片段或無背景樂的直播錄影

上述素材本身就沒有複雜的背景音樂,且錄音環境相對乾燥。將這類素材丟入系統,經過一次普通的去底噪或去回音,出來的品質將是完美的「零瑕疵乾聲」。

04. 詳細操作流程

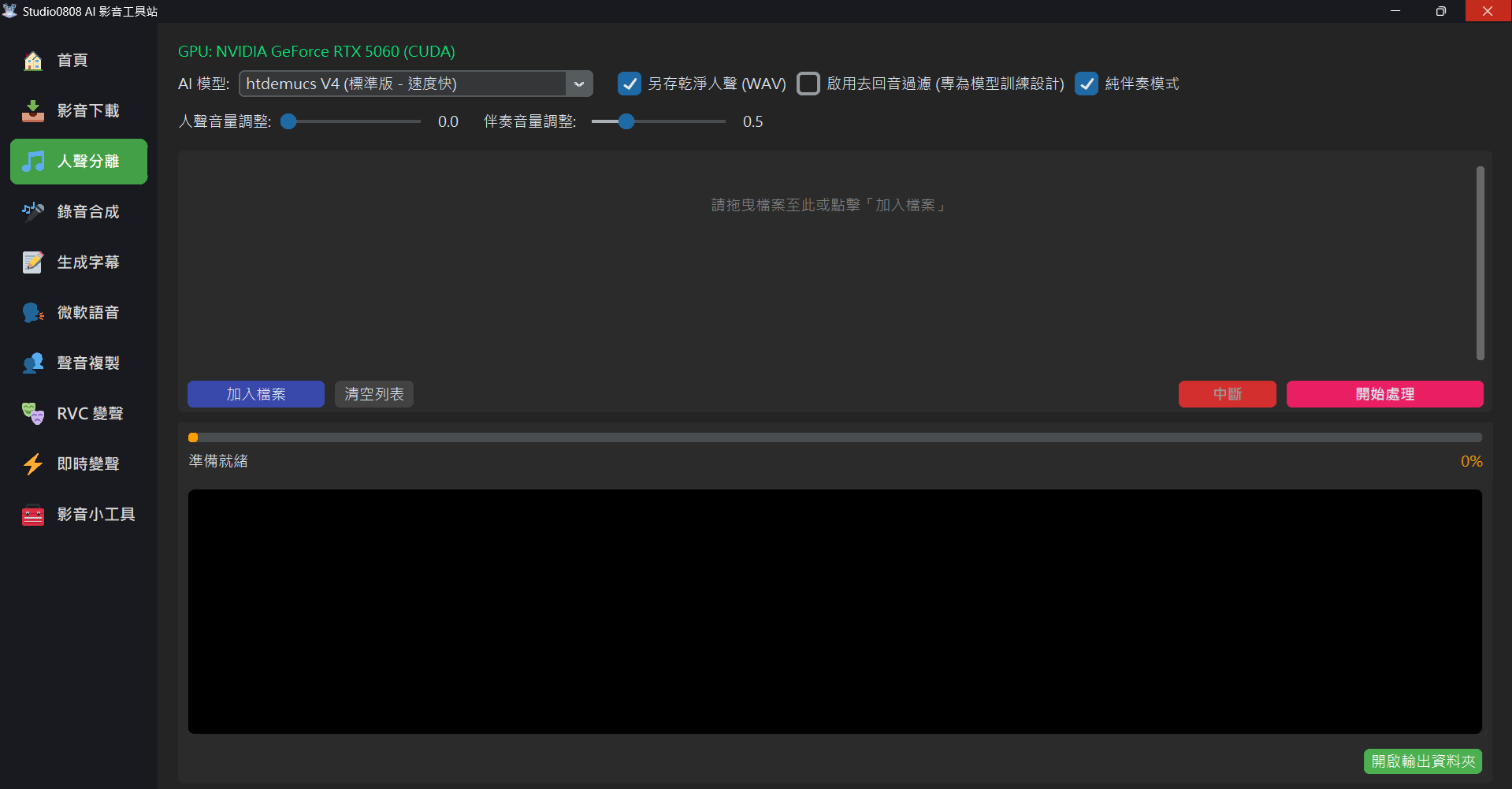

- 選擇檔案:直接將音訊或影片檔拖曳到程式視窗中,或者點擊「加入檔案」。支援批次處理。

- 選擇模型:在上方下拉選單選擇您需要的模型 (預設使用標準版)。

- 設定選項:

- 另存乾淨人聲 (WAV):強烈建議勾選。這會將分離出來的人聲獨立儲存為高品質 WAV 檔,方便後續編輯。

- 純伴奏模式:如果勾選,程式會自動將鼓、貝斯、其他樂器混合成一個「伴奏檔」,方便您直接拿來唱歌。

- 開始處理:點擊橘色按鈕,程式將自動調用 GPU (若可用) 進行高速運算。

💡 提示:處理後的檔案會自動儲存在 Outputs/Vocals 資料夾中。

04. 常見問題 (Q&A)

Q: 為什麼處理速度很慢?

A: 深度學習模型需要大量的矩陣運算。如果您使用 NVIDIA 顯示卡 (GPU),速度通常是 CPU 的 10~50 倍。若您只有 CPU,則需要較長的等待時間。

Q: 為什麼第一首歌處理特別久?

A: 第一次使用新模型時,程式需要從雲端下載模型權重檔 (約數百 MB)。之後再使用就會非常快了。

Q: 出現 "Out of Memory" 錯誤?

A: 這表示您的顯示卡 VRAM 不足。不用擔心,本程式 具備 自動 fallback 機制,偵測到記憶體不足時會自動切換回 CPU 模式繼續完成任務。

Q: 本程式 可以直接幫我去回音嗎?

A: 可以!從 V2.3 版本開始,本程式 原生整合了 UVR5 的 VR Architecture 頂級去回音模型。

您只需要在介面上勾選 「☑️ 啟用去回音過濾 (專為模型訓練設計)」。系統在分離出人聲後,會自動在背景啟動第二次的 AI

神經網路運算,對人聲進行殘響抽離,最後自動為您輸出完美無瑕的 _Vocal_Dry.wav。這個檔案可以直接丟進 RVC 或 GPT-SoVITS

進行訓練,無須再依賴外部軟體!

05. 核心技術規格 (Core Specs)

本功能基於以下開源技術構建,確保最佳的相容性與效能:

- AI Engine: Demucs (Hybrid Transformer) & MDX-Net

- Deep Learning Framework: PyTorch (with CUDA Acceleration)

- Audio Processing: FFmpeg (for high-quality encoding/decoding)

- Vector Search: Faiss (for feature retrieval)